Bon, ça y’est, j’ai 60 ans maintenant, dont 28 ans à faire du Digital Marketing, 23 ans à faire du SEO et dix ans à travailler sur les LLMs. Et on me qualifie souvent de « Dinosaure » dans la profession. Et quelque part, j’en suis certainement un.

Du coup j’ai décidé d’assumer complètement cette appellation. Je suis bel et bien un Dinosaure. Donc j’ai inventé un avatar de Dino rigolo qui me va bien. Et qui va accompagner ma comm régulièrement maintenant.

Bon après, je suis un Dino qui a survécu à la météorite de Chicxulub, qui fait de la veille tous les jours, qui teste et apprend des nouvelles choses, et qui se sert de son expérience pour voir ce que nous réserve demain. La nostalgie, c’est pas mon truc. Ne comptez pas sur moi pour dire « c’était mieux avant » (sauf dans quelques cas où c’était vraiment mieux avant, ça existe), mais plutôt pour jeter un regard enthousiaste et lucide à la fois sur ce que nous prépare l’avenir (notamment avec l’IA qui me passionne).

Aujourd’hui, je prends la parole pour dire tout haut ce que beaucoup de praticiens pensent tout bas : le GEO, tel qu’on vous le vend en 2026, est une escroquerie intellectuelle. Pas la discipline en elle-même, qui finira par exister un jour. Mais le cirque commercial qui l’entoure aujourd’hui.

GEO : un nom populaire, mais le pire choix pour désigner ces optimisations

Commençons par le commencement. GEO signifie Generative Engine Optimization, par analogie avec le SEO (Search Engine Optimization, l’optimisation pour les moteurs de recherche). L’idée est séduisante sur le papier : puisque les utilisateurs interrogent de plus en plus des outils comme ChatGPT ou Perplexity, il faudrait une nouvelle discipline pour optimiser sa visibilité dans ces « moteurs génératifs ».

Le problème, c’est que les moteurs génératifs n’existent pas vraiment. Ce que l’on a aujourd’hui, ce sont deux choses distinctes. D’un côté, des moteurs de recherche classiques augmentés de fonctionnalités IA : les AI Overviews de Google (ces résumés générés par IA qui s’affichent au-dessus des résultats organiques, déployés aux Etats-Unis mais pas encore en France), le mode IA. De l’autre, des outils d’IA générative dopés par une couche de RAG (Retrieval Augmented Generation), un mécanisme qui permet à un LLM (Large Language Model, le modèle de langage au coeur de ChatGPT, Claude ou Gemini) d’aller chercher des informations fraîches dans un index web avant de formuler sa réponse.

En clair, les éditeurs de LLMs trichent. ChatGPT Search s’appuie sur l’index de Bing. Perplexity fait la même chose. Sans moteur de recherche « à l’ancienne » en coulisses, ces outils ne pourraient pas répondre à vos questions d’actualité. Les vrais moteurs de recherche 100 % IA, ceux qui se passeraient complètement d’un index web classique, sont encore dans les laboratoires de recherche. Ce que l’on appelle « moteurs génératifs » aujourd’hui, ce sont fondamentalement des interfaces conversationnelles posées sur une infrastructure de recherche traditionnelle.

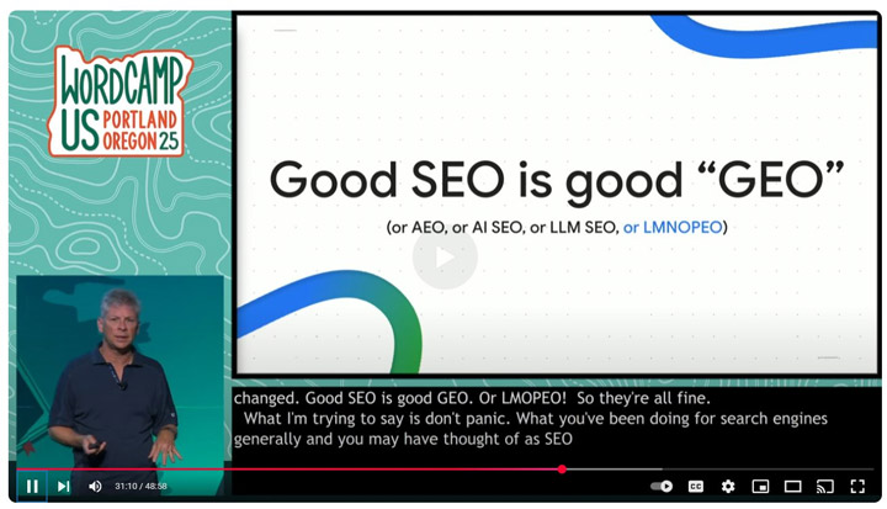

Danny Sullivan, le porte-parole de Google Search, l’a résumé lors du WordCamp US en septembre 2025 : « Good SEO is good GEO. » Quel que soit l’acronyme que vous choisissiez, GEO, AEO, LLMO, AI SEO, les bonnes pratiques restent les mêmes. Gary Illyes, son collègue, a été encore plus direct : utilisez les pratiques SEO normales, vous n’avez besoin ni du GEO, ni du LLMO, ni de quoi que ce soit d’autre. Quand les deux voix les plus écoutées de Google Search vous disent que le GEO est du SEO avec un chapeau, il serait temps de les écouter.

Les outils GEO actuels mesurent un mirage

Si le GEO en tant que discipline reste flou, le marché des outils GEO, lui, est bien réel. Et c’est sans doute là que se trouve la vraie arnaque.

On dénombre aujourd’hui des dizaines de plateformes dédiées en France : GetMint, Meteoria, Qwairy, Atyla, Semji, Peec AI, Fasterize… A l’international, la liste est encore plus longue : Profound, AthenaHQ, Otterly AI, GrackerAI, ZipTie, Scrunch AI, Rankability, et j’en passe. A cela s’ajoutent les briques GEO désormais intégrées dans les suites SEO classiques comme Semrush, Ahrefs, SE Ranking, Surfer SEO, Frase, Keyword.com, Conductor, Search Atlas, seoClarity ou Pi Datametrics. Beaucoup ont considéré que c’était la poule aux oeufs d’or. En réalité, vu la concurrence, beaucoup vont disparaître avant d’avoir fait fortune.

Le problème fondamental, c’est que leur pitch commercial repose sur deux hypothèses fausses.

Première hypothèse : les réponses des LLM seraient stables et mesurables par échantillonnage périodique. Or c’est faux. Les LLMs génèrent des réponses de façon probabiliste, influencées par la version du modèle, le contexte de session, la formulation du prompt, le paramètre de température (le degré d’aléatoire dans la génération de texte) et les mises à jour continues du modèle. Une marque citée dans une session ChatGPT peut être totalement absente la minute suivante pour la même requête. Un outil qui échantillonne une fois par jour ou par semaine mesure une cible mouvante à travers un trou de serrure.

Deuxième hypothèse : la fréquence de citation équivaudrait à la qualité de citation. C’est tout aussi faux. Être mentionné comme « meilleur prestataire du marché » et être mentionné à cause d’une fuite de données massive, ce n’est pas du tout la même chose. Pourtant, beaucoup de dashboards agrègent tout dans un score unique de « visibilité IA », sans distinguer le sentiment, le cadrage, ni même la véracité de la mention (qui peut être une pure hallucination du modèle).

Au-delà de ces deux hypothèses structurelles, la méthodologie de ces outils pose de nombreux autres problèmes :

- Inconsistance temporelle : les réponses LLM varient au sein d’une même journée. Les outils qui échantillonnent une ou deux fois par semaine ratent la variance intra-journalière et produisent des faux positifs.

- Fragmentation des versions : plusieurs versions d’un même modèle tournent simultanément (GPT-5 affiche 1,4 % d’hallucination quand les anciennes versions de ChatGPT atteignaient environ 33 %). Les éditeurs d’outils GEO ne précisent presque jamais quelle version ils interrogent.

- Aucune prise en compte des hallucinations : si le LLM invente une recommandation pour votre marque, est-ce une bonne ou une mauvaise chose ? Les outils ne font pas la différence.

- Cécité contextuelle : certains outils comptent les mentions mais ignorent le cadrage. Un dashboard « positif » peut masquer du sentiment négatif ou de la désinformation.

- Problèmes d’attribution cross-plateforme : agréger les résultats de ChatGPT, Gemini et Perplexity dans un score unique crée de l’ambiguïté. Un progrès de « visibilité IA » peut être entièrement porté par une seule plateforme, non représentative de votre audience.

- Opacité du sampling : les clients n’ont aucun moyen d’évaluer la significativité statistique des résultats. Pas d’intervalles de confiance, pas de détails sur les volumes de requêtes, pas de transparence méthodologique.

Ajoutez à cela qu’il n’existe aucune API officielle de type Search Console pour les « rankings IA ». Les outils simulent des requêtes via API ou sessions headless, avec des rate limits et un décalage potentiel avec l’expérience utilisateur réelle. Certains revendiquent 95 % de précision, mais sans fournir la moindre preuve.

Le tout pour des tarifs souvent prohibitifs : la plupart de ces outils coûtent pour deux ou trois sites pendant un mois ce qu’un outil SEO classique coûte pendant un an.

Faut-il pour autant les jeter ? Pas forcément, si votre direction vous bombarde de questions sur la visibilité IA de votre marque. Dans ce cas, prenez les résultats avec des pincettes, croisez plusieurs outils et payez le minimum. Mais ne fondez aucune décision stratégique dessus. Celui qui fera véritablement de l’argent avec un outil GEO sera celui qui inventera une méthodologie correcte, capable de produire des indicateurs fiables et d’en tirer des conclusions actionnables. Pour le moment, on en est loin.

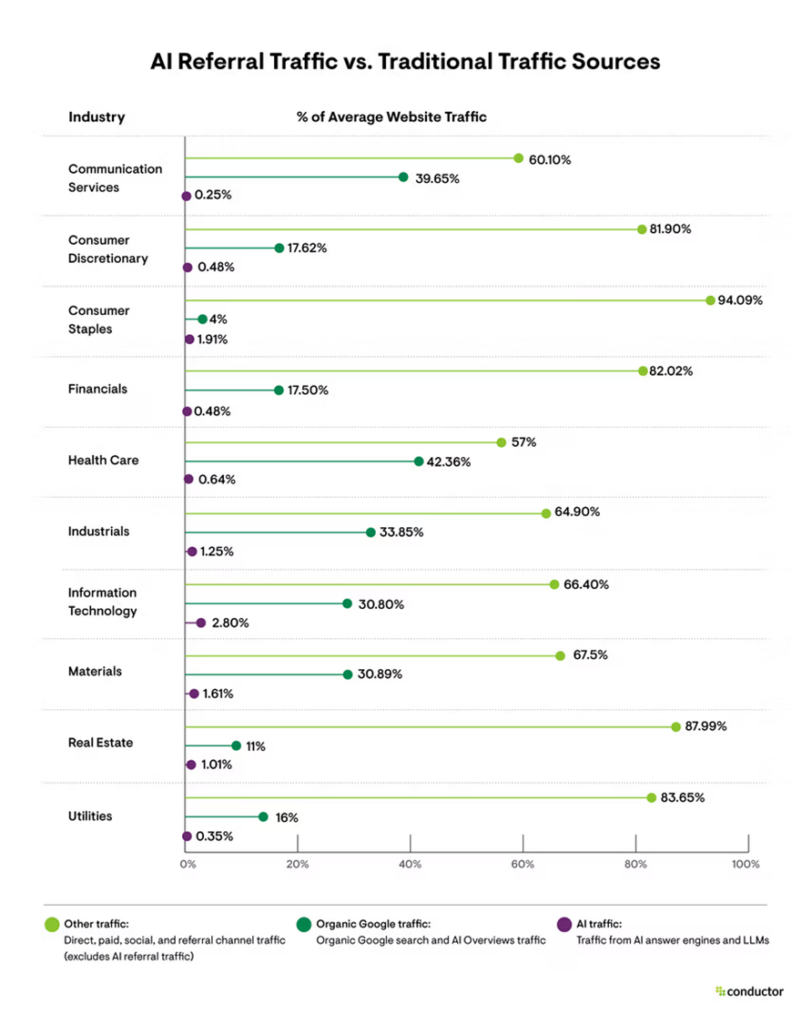

Le trafic IA reste anecdotique : les chiffres parlent

Venons-en à l’argument massue. A quoi bon investir dans le GEO si le trafic envoyé par les outils d’IA est négligeable ?

Les données du rapport Conductor AEO/GEO Benchmarks sont sans appel : en moyenne, le trafic référent envoyé par les outils d’IA représente 1,08 % du trafic total d’un site, tous secteurs confondus. Le secteur le mieux loti, l’IT, atteint 2,80 %. A comparer avec le trafic organique Google, qui représente entre 30 % et 94 % selon les industries. On parle d’un rapport de 1 à 30 dans le meilleur des cas, et de 1 à 375 dans le pire.

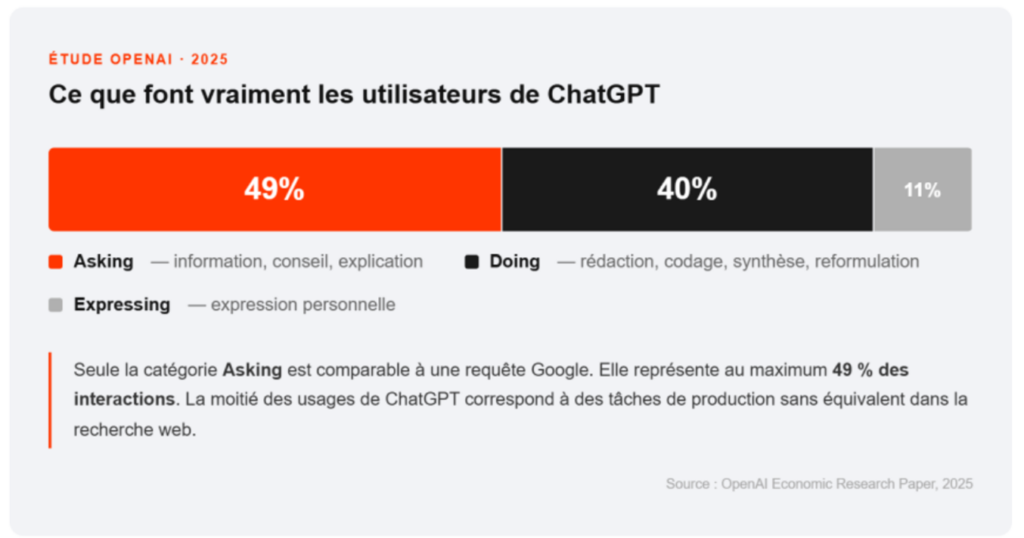

L’étude interne d’OpenAI sur les usages de ChatGPT, publiée en 2025, le confirme par un autre angle. Seuls 49 % des échanges avec ChatGPT relèvent de la catégorie « Asking » (recherche d’information, conseil, explication), la seule catégorie comparable à une requête Google. Les 40 % qui suivent concernent des tâches de production (« Doing » : rédaction, codage, synthèse, reformulation) et 11 % de l’expression personnelle (« Expressing »). Autrement dit, plus de la moitié des usages de ChatGPT n’ont aucun équivalent dans un moteur de recherche. On ne parle pas de substitution, on parle de création d’un nouvel usage.

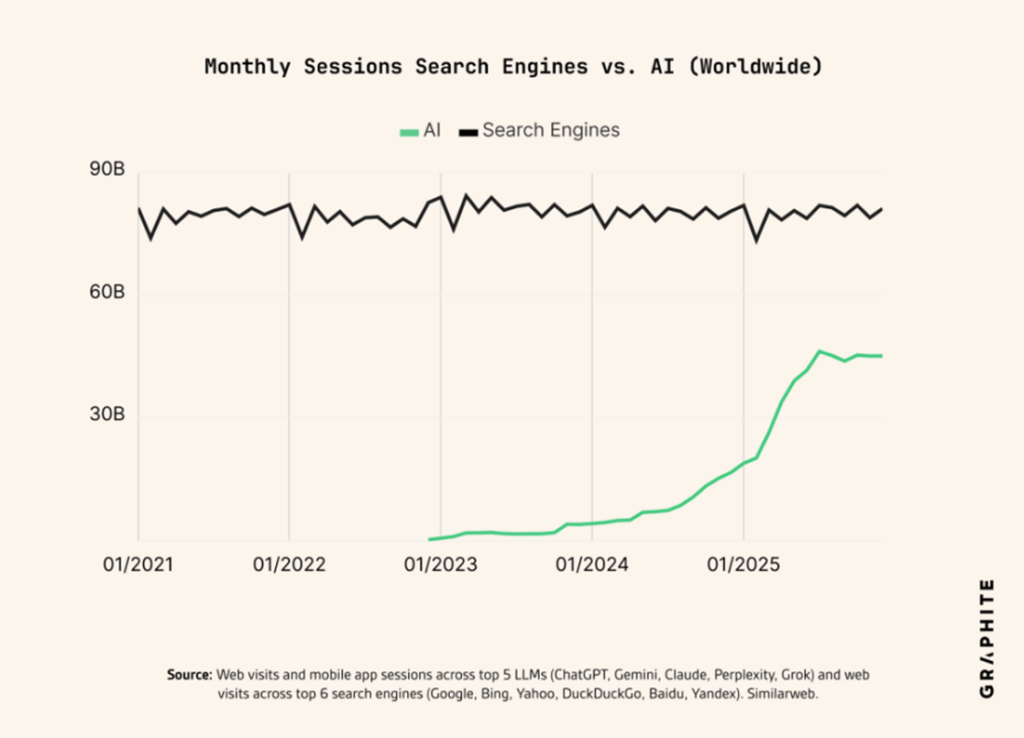

Les données Semrush enfoncent le clou : les utilisateurs de ChatGPT passent en moyenne de 10,5 à 12,6 sessions Google par semaine après avoir adopté l’outil. Et 95 % des utilisateurs de ChatGPT utilisent aussi Google, selon Similarweb. ChatGPT ne remplace pas Google, il étend le périmètre global de la recherche d’information. La croissance simultanée de Google et de ChatGPT n’est pas un paradoxe : ce sont deux courbes qui montent en parallèle parce qu’elles répondent à des comportements différents.

Google n’a pas perdu la partie, bien au contraire

Pendant que certains consultants prédisent que ChatGPT dépassera Google en 2030 (on prend les paris ?), les données montrent une réalité bien différente.

Google ne perd pas de trafic, alors que les IA Génératives sont en forte progression. Ce que l’on vit, c’est l’apparition d’usages parallèles pour l’essentiel.

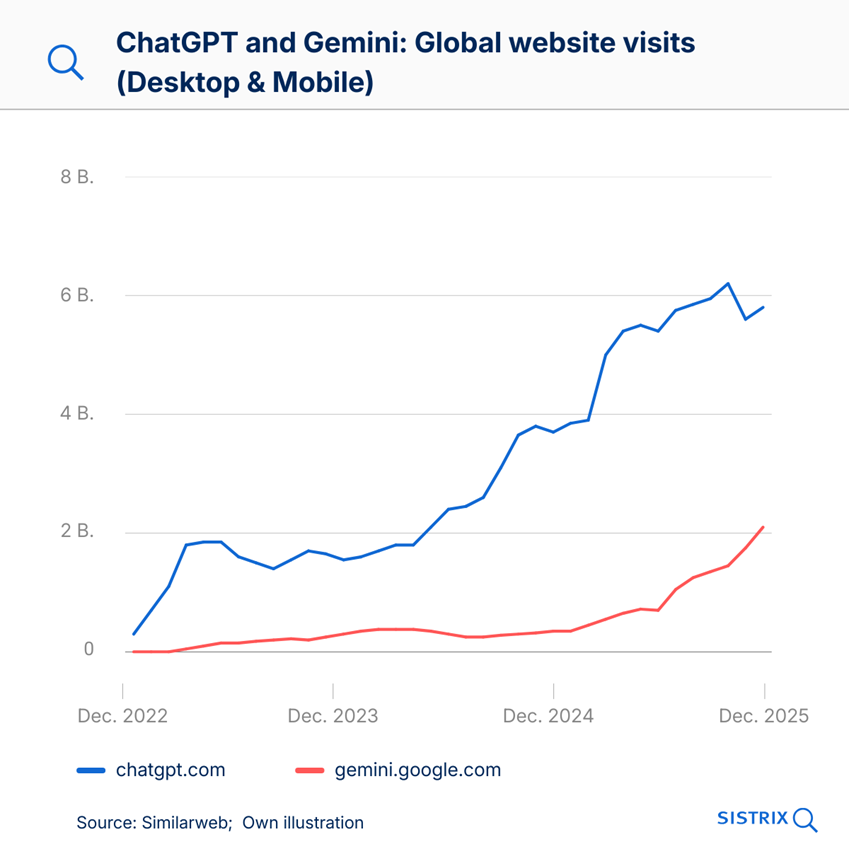

Gemini progresse rapidement en parts de voix tandis que la croissance de ChatGPT en nombre de visites marque le pas. Google dispose de ses propres modèles d’IA désormais régulièrement placés dans le trio de tête des benchmarks, seul Anthropic et Claude continuant à les devancer sur certains critères. Google possède surtout un actif stratégique que tous ses concurrents envient : son index web. Sans accès à un index de cette qualité, ChatGPT Search, Perplexity et les autres ne peuvent pas fonctionner correctement. Google dispose aussi d’un modèle économique viable (quand OpenAI peine encore à lancer la publicité sur ses outils), d’une indépendance relative vis-à-vis de Nvidia (quand ses concurrents dépensent trois à cinq fois plus pour leur infrastructure), et surtout de la capacité à imposer les usages IA directement à ses milliards d’utilisateurs existants via les AI Overviews, le mode IA, et demain un moteur de recherche entièrement repensé pour l’IA.

Que faire concrètement en 2026 ?

La réponse tient en quatre chantiers, classés par ordre de priorité et de ROI.

1. Continuer à faire du SEO moderne.

Pas les recettes de cuisine de 2007, mais du SEO post-Helpful Content Update. Cela signifie optimiser vos scores de PQ (Page Quality, la qualité intrinsèque de la page évaluée par Google) et de PU (Page Utility, l’utilité concrète de la page pour l’utilisateur), lire attentivement les Quality Raters Guidelines, travailler votre marque et votre notoriété bien au-delà du seul canal search. Les contenus optimisés uniquement pour les moteurs, les pages satellites, les cocons sémantiques moisis faits uniquement pour Google : c’est du passé.

2. Se préparer aux AI Overviews et au mode IA de Google.

Les AI Overviews ne sont pas encore déployés en France, mais ce n’est qu’une question de temps. On peut dès maintenant adapter ses guidelines de rédaction de contenu pour être prêt le jour J. Cela passe par le chunking (structurer ses contenus en blocs autonomes et clairement titrés, facilement extractibles par un système RAG), la topical breadth (couvrir la largeur des questionnements de son audience sur un sujet donné), et l’optimisation pour les citations (sourcer ses informations, indiquer ses références dans ses contenus). Ces optimisations sont aussi excellentes pour le SEO classique. En pratique, il s’agit essentiellement de mettre à jour vos chartes éditoriales et vos briefs de rédaction.

3. Ne pas optimiser spécifiquement pour ChatGPT, Claude, Perplexity ou DeepSeek.

Le ROI est négatif. La question est simple : est-ce que vous avez déjà optimisé votre site spécifiquement pour Bing ? Probablement pas, et Bing envoie encore plus de trafic que l’ensemble des outils d’IA réunis. Alors pourquoi consacreriez-vous du budget à des sources de trafic encore plus marginales ? Ne cédez pas à la hype. Et n’écoutez pas ceux qui vous vendent des fichiers LLMs.txt ou des convertisseurs de site au format Markdown : ces gadgets n’ont eu qu’une durée de vie de quelques semaines à quelques mois.

4. Surveiller les signaux faibles.

Configurez votre web analytics pour tracer le trafic référent provenant des LLMs. Surveillez votre visibilité dans les outils IA, non pas comme un KPI opérationnel, mais comme un indicateur de votre notoriété multicanal et de votre e-réputation. Et gardez un oeil attentif sur les protocoles émergents comme l’UCP (Universal Commerce Protocol, le protocole lancé par Google pour standardiser les transactions commerciales entre agents IA et marchands) et le MCP (Model Context Protocol, le protocole d’Anthropic qui permet aux LLMs d’interagir avec des services tiers). Si ces protocoles se généralisent, ils pourraient changer la donne pour le e-commerce bien plus profondément que le GEO tel qu’on le conçoit aujourd’hui.

Quand est-ce que cela va changer ?

Les choses évolueront, probablement aux alentours de 2028-2029. Le temps que les usages IA s’accroissent encore côté moteurs de recherche, que des innovations rendent le SEO traditionnel moins efficace et les optimisations GEO plus rentables, et que les protocoles UCP et MCP viennent créer des usages marchands qui court-circuitent les sites internet traditionnels.

Mais aujourd’hui, lâcher la proie pour l’ombre serait une erreur stratégique majeure. Le Search est resté le canal le plus important, et souvent le canal majoritaire, pour la plupart des sites en 2025. Il le sera encore en 2026. Les modèles économiques réellement en danger ne sont pas ceux de tout le monde : ce sont ceux qui dépendent entièrement du trafic envoyé par Google (modèle publicitaire pur) ou qui revendent ce trafic (sites d’affiliation, comparateurs). Pour les autres, la consigne est claire : restez concentrés sur ce qui compte vraiment.

Bibliographie

- OpenAI Economic Research Paper : ChatGPT Usage (2025)

- Semrush : ChatGPT Is Not Replacing Google, It’s Expanding Search

- Conductor : AEO/GEO Benchmarks Report

- Business Insider : AI Search Reshapes SEO, Fueling GEO Gold Rush (novembre 2025)

- Neper : AI Search, Google est en train de gagner la partie

- Neper : Le chunking, comment rédiger des contenus optimisés pour le GEO et le SEO

- Neper : UCP, ACP, Rufus : la guerre des protocoles qui va redessiner le e-commerce

- Google Search Central : Helpful Content Update