Lors de l’épisode du faux départ de Sam Altman, beaucoup de commentateurs ont mentionné les inquiétudes exprimées par certains membres du board d’Open AI, mais aussi par certains employés de la société à propos d’un projet interne baptisé Q Star.

Q Star serait une IA de type AGI (Artificial General Intelligence).

Or l’apparition d’une ou plusieurs AGI est de nature à créer de sérieux problèmes éthiques et sociétaux. Faut-il avoir peur de Q *, comme certaines personnes l’affirment ? Nous allons essayer de debunker tout ça …

C’est quoi une Intelligence Artificielle Générale

Le concept d’AGI est pour l’instant théorique : il désigne des outils d’IA embarquant la plupart des capacités cognitives humaines y compris des capacités de raisonnement. Une Intelligence Artificielle Générale digne de ce nom est en principe capable de prendre en charge n’importe quelle nouvelle tâche et de la gérer à peu près comme un cerveau humain.

D’après Reuters, l’une des raisons qui a poussé le conseil d’administration a « virer » avec pertes et fracas le CEO d’Open AI (avant de devoir rétropédaler et le réintégrer quelques jours après) serait la découverte par des membres éminents du Board de l’existence de Q Star, jusqu’ici gardé secret.

Cette version de l’histoire n’a pas été confirmée par Open AI.

Par contre, l’existence du projet Q * a bel et bien été confirmée.

Q Star, une AGI ?

Q Star n’est probablement pas une AGI, et en est même probablement encore très éloignée. Beaucoup de spécialistes pensent qu’il faudra encore attendre quelques dizaines d’années de recherche avant d’y arriver, et certains doutent même de la possibilité de créer une véritable AGI un jour.

D’après ce qui a fuité (pas grand chose, précisons le à ce stade), Q Star ne serait qu’une avancée vers des outils d’IA moins idiots que les IA Génératives actuelles. Mais au même titre que Gemini de Google par exemple.

D’après Yann Le Cun (le Français qui dirige le labo de Meta sur l’IA : FAIR), il ne s’agirait que d’une avancée sur l’emploi d’une méthode de planification (planning) pour remplacer les outils de prediction de token autoregressifs.

Si vous voulez en savoir plus sur ces modèles, voici un papier en anglais qui vous dit tout sur ce concept à la base des différentes versions de GPT :

https://medium.com/@akash.kesrwani99/understanding-next-token-prediction-concept-to-code-1st-part-7054dabda347

Q Star = Q Learning + A Star Search ?

Bizarrement, dès qu’on connait un peu l’état de l’art dans la recherche sur les modèles d’IA, le nom Q Star rappelle deux choses :

- le Q Learning, une des nombreuses méthodes spécifiques d’apprentissage automatique par renforcement : https://fr.wikipedia.org/wiki/Q-learning

- et le A Star Search : un algorithme qui aide les machines à trouver la meilleure solution possible de manière efficace : https://fr.wikipedia.org/wiki/Algorithme_A*

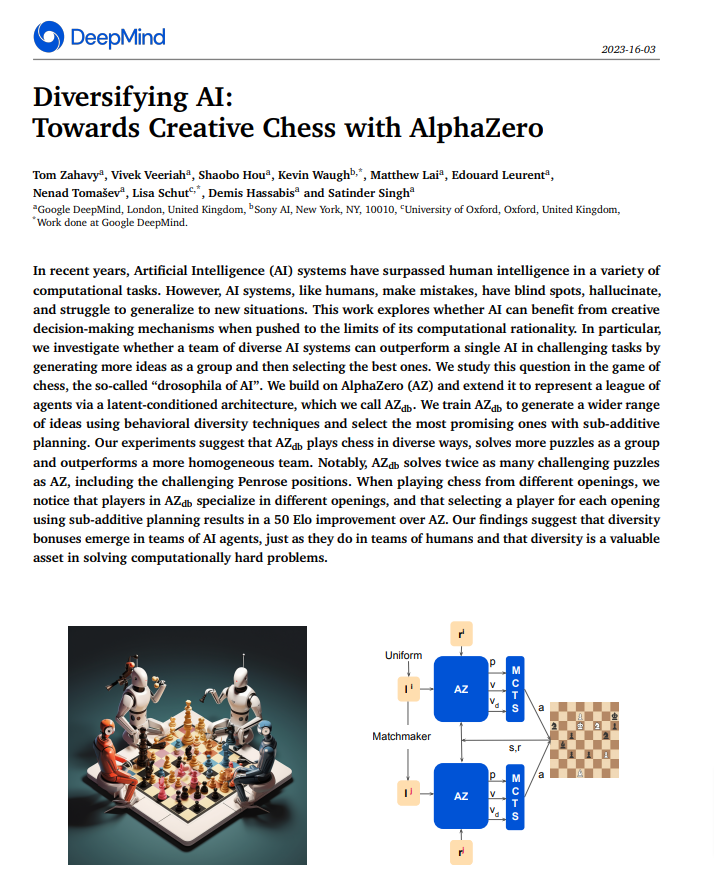

La combinaison Q Learning et A * se retrouve déjà dans un outil d’IA développé par Deepmind (à l’époque de Google) baptisé AlphaZéro, sorti dans sa première version en 2017.

Or ce qui a fuité à propos de Q Star semble n’être qu’une version survitaminée et plus générique d’AlphaZero.

Un papier scientifique récent de Deepmind à propos d’Alphazero, expliquant comment leur approche appliquée au jeu d’échecs permet d’améliorer les performances des logiciels.

On est loin de l’Intelligence Artificielle Générale ! Pas de Skynet en vue, ni de soulèvement des machines.

Conclusion : Q Star ne doit pas inquiéter, au contraire

En fait, c’est logique qu’Open AI et tous ses concurrents travaillent à rendre les LLM actuels plus efficaces et plus fiables, et donc plus utiles, en ajoutant une couche dite de « planification ». Donc quelque chose qui leur donne une meilleure capacité à résoudre des problèmes (simples pour commencer).

Ce que l’on va voir arriver dans les prochains mois, ce sont juste des IA capables de faire vraiment ce que la plupart des gens pensent que ChatGPT 4 est déjà capable de faire.

OpenAI vit depuis un an sur un malentendu : ses outils sont capables de générer des jolis textes remplis d’informations plausibles (pas forcément justes), mais avec des capacités de raisonnement tellement limitées que c’en est drôle. Et c’était vrai chez la plupart de ses concurrents aussi.

Les prochains mois vont être passionnants à suivre, car le feuilleton des nouvelles IA capables de prouesses toujours plus importantes aura probablement de très nombreux nouveaux épisodes.