Depuis 2024, une part croissante du trafic sortant vers les sites web ne vient plus d’un navigateur humain, ni même d’un crawler classique comme Googlebot.

Elle vient d’agents IA qui récupèrent des URL pour le compte d’un utilisateur. ChatGPT lit une page partagée dans un chat. Perplexity compose sa réponse à partir de plusieurs sources fetchées en temps réel. Claude consulte un article cité dans une conversation. Gemini vérifie un fait au fil d’une requête. Ce trafic n’est pas limité à la documentation développeur, qui a concentré jusqu’ici l’essentiel de l’attention.

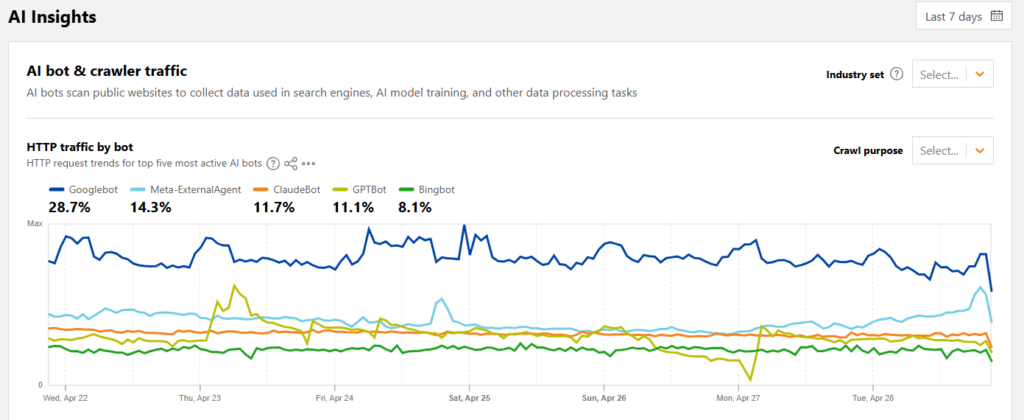

Le trafic des bots IA d’après Cloudflare Radar

N’importe quelle page web, fiche produit, article de presse, page institutionnelle, billet de blog, peut être consommée par ces clients, dans des conditions qui diffèrent de la visite humaine.

Plutôt qu’un nouveau métier ou une nouvelle discipline baptisée d’un acronyme supplémentaire, ce qui se joue est l’extension du périmètre technique du SEO à un nouveau type de « lecteur ». Les contraintes changent, les fondamentaux restent.

Optimiser pour les agents IA, c’est majoritairement des recommandations qui recoupent les prérequis SEO, mais il y’a aussi des choses plus spécifiques : voyons cela plus en détail.

Typologie des agents qui consultent vos pages

Le trafic agent recouvre quatre réalités techniques assez différentes, qu’il faut distinguer avant de parler optimisation.

Les crawlers d’entraînement d’abord, qui passent à l’échelle sur l’ensemble du web. Ils alimentent les corpus d’apprentissage ou les index de retrieval des fournisseurs de LLM. Il s’agit notamment de GPTBot (OpenAI), ClaudeBot (Anthropic), Google-Extended (Google), PerplexityBot, Bytespider (ByteDance). Cloudflare a documenté publiquement une croissance à trois chiffres de ces bots depuis 2024.

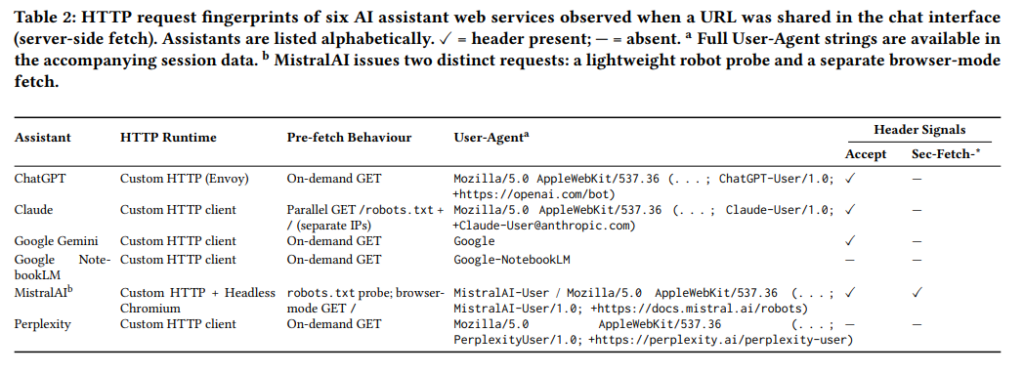

Les fetchers temps réel ensuite, déclenchés par une requête utilisateur sans passer par un index préconstruit. Quand un utilisateur colle une URL dans ChatGPT ou Claude, quand Perplexity construit une réponse en direct, la plateforme fetche la page à ce moment-là, souvent avec un user-agent distinct du crawler d’entraînement.

Les assistants agentiques intégrés au navigateur, troisième catégorie. Claude dans Chrome, Gemini dans Chrome, les extensions tierces. Ils consultent des pages au fil de la navigation de l’utilisateur, parfois sans user-agent spécifique.

Les agents de codage enfin, plus spécialisés, comme Claude Code, Cursor ou Cline. Pertinents pour les éditeurs qui publient des URL techniques (API, spécifications, documentation), ils constituent le cas le plus étudié dans la littérature académique récente.

Ce qui change techniquement pour une page web

Quatre contraintes structurelles distinguent ces clients de l’utilisateur humain et même de Googlebot.

La faiblesse du rendu JavaScript d’abord. La majorité des agents fetchent le HTML initial sans exécuter le JS côté client, ou avec un rendu headless très limité. Un contenu injecté via hydratation après chargement est invisible pour ces clients. C’est une contrainte que partage Googlebot depuis longtemps, mais poussée à l’extrême : là où Googlebot tente un rendu différé, un agent de codage ou un fetcher temps réel abandonne immédiatement.

La navigation compressée ensuite. Une étude publiée en 2026 sur les signatures HTTP de neuf agents de codage majeurs montre que le parcours multi-pages s’effondre en une ou deux requêtes. Pas de session, pas de parcours interne valorisé, pas de clic sur un lien de navigation. Chaque URL doit être autosuffisante dans ce qu’elle communique.

La lecture sous contrainte de tokens, troisième différence et probablement la plus structurante. Un token est l’unité de base qu’un modèle de langage consomme, approximativement un mot court ou un morceau de mot. La page est ingérée dans une fenêtre de contexte limitée, typiquement 100 000 à 200 000 tokens selon le modèle. Au-delà, l’agent tronque, découpe, ou abandonne purement et simplement la ressource. Une page lourde avec navigation, sidebar, footer, bannières et scripts peut dépasser 15 000 tokens dont une grande partie est du bruit.

L’absence de signal comportemental en retour, enfin. Pas de scroll, pas de clic, pas de partage. La page est lue une fois, synthétisée, et le résultat est consommé ailleurs que sur le site. Aucun signal de qualité ne remonte à l’éditeur par les moyens habituels.

Les comportements spécifiques des agents IA identifiés dans l’étude de Cisco. Attention ce comportement change rapidement.

Les fondamentaux SEO font déjà l’essentiel du travail

Attention à ne pas réinventer le fil à couper le beurre : en matière de GEO, quand je lis les recos, j’ai souvent cette image en tête.

La majorité de ce qui rend une page lisible par les agents relève de bonnes pratiques connues depuis des années, que tout site correctement travaillé côté SEO technique applique déjà. Les agents IA ont par contre des capacités plus limitées que Googlebot et Bingbot, donc leur seuil d’acceptation est plus bas.

Le rendu serveur ou le pré-rendu reste la première exigence. Pour les sites construits en React, Vue, Next.js, Nuxt ou équivalents, servir un HTML initial contenant le contenu principal est devenu non négociable. Le sujet n’est pas neuf, il est central pour l’indexation Google depuis 2018. Il prend simplement une dimension supplémentaire avec les agents, qui rendent encore moins le JS que Googlebot.

La qualité du HTML ensuite. Hiérarchie de titres cohérente avec un H1 unique et pas de saut de niveau, tables HTML natives pour les données tabulaires plutôt que des listes reformulées en prose, balises sémantiques (<article>, <main>, <nav>, <aside>). Ce sont les mêmes exigences que celles portées par l’accessibilité, et elles bénéficient à tous les clients machine. Googlebot est assez permissif sur ces détails, pas un agent IA

Le poids HTML raisonnable, ensuite. Un HTML léger sert Googlebot, les utilisateurs sur connexion faible, et désormais les agents qui comptent en tokens. Le sujet n’a pas changé de nature, il a gagné une nouvelle justification.

L’audit du robots.txt, plus souvent nécessaire qu’on ne le croit. Beaucoup de sites ont bloqué GPTBot, ClaudeBot ou Google-Extended à un moment donné, parfois à la hâte en 2023–2024, et n’en gardent pas trace. Si l’intention éditoriale actuelle est de laisser passer ces agents, une vérification s’impose.

Les données structurées schema.org enfin. Product, Article, Organization, FAQ, HowTo. Elles restent lues par Google et sont désormais exploitées par les agents pour construire leurs réponses. Leur intérêt augmente pour les agents IA.

Ce qui est réellement spécifique aux agents

Il reste néanmoins une couche qui, elle, est nouvelle et mérite un traitement dédié.

Le poids en tokens devient une métrique technique à part entière, distincte du poids HTML exprimé en kilooctets. Un repère simple : diviser le nombre de caractères HTML par quatre donne une estimation à la louche du poids en tokens. La littérature cite le cas d’une page de documentation Cisco Firewall Management à 193 217 tokens, au-delà de la fenêtre de contexte utile de la plupart des agents. Le cas est extrême, mais sur un site éditorial classique le problème existe aussi : un long-read avec galerie commentée, sidebar, encadrés et pavé de recommandations dépasse facilement 15 000 tokens utiles. Au-delà d’un certain seuil, un agent cesse d’ingérer la page intégralement.

La réduction du bruit de contenu qui en découle. Sidebars, bandeaux, footers, navigation, pop-ins, scripts de tracking, tout cela pèse en tokens côté agent sans rien apporter à la compréhension du contenu. Un site peut servir la même page avec ou sans chrome. Certains éditeurs exposent déjà une version « lecture » ou « print » ; elle peut servir d’endpoint agent-friendly sans développement supplémentaire.

La mise en ligne d’une version Markdown ou d’un endpoint simplifié est par contre inutile. Aucun standard n’a émergé pour le LLMs.txt, et la pratique a de sérieux inconvénients. La vraie solution, c’est d’alléger votre code et le rendre plus lisible par les bots. Dans les cas extrêmes, si vous détectez un agent IA, lui délivrer une version Markdown est une béquille possible, mais ce n’est pas une solution élégante ni durable.

Le standard AGENTS.md, enfin, mais avec une précision importante : il concerne les repos de code, pas les sites web. Pertinent pour les éditeurs qui maintiennent des SDK, bibliothèques ou projets open-source publiquement disponibles. Adopté depuis août 2025 par plus de 60 000 projets, passé sous la tutelle de la Linux Foundation via l’Agentic AI Foundation en décembre 2025, c’est l’un des rares standards agentiques réellement établis. Pour un éditeur de site média ou de e-commerce, il n’est pas directement applicable.

Un chantier à intégrer au SEO technique existant

Il faut refuser le piège des acronymes qui s’accumulent (GEO, AEO, LLMO, et quelques autres) et qui cachent un grand vide derrière. On assiste à l’extension du périmètre technique du SEO à un nouveau type de client.

Ce sont les spécialistes SEO qui savent gérer le crawl budget, le rendu serveur, le poids HTML, le robots.txt et les données structurées qui sont les mieux placés pour prendre en charge les enjeux liés aux visites des agents IA.

Comment traiter ces nouveaux sujets techniques concrètement

- Audit immédiat, en quelques heures : robots.txt, poids HTML, rendu serveur, hiérarchie des titres, données structurées. Le bénéfice sera immédiat, quel que soit le niveau de trafic agent.

- Chantier court terme : mesure du poids en tokens sur les pages clés, nettoyage du chrome de page, renforcement schema.org, exposition éventuelle de versions allégées.

- Veille moyen terme : suivi de l’évolution des standards émergents (AAIF, MCP, spécifications futures) sans précipitation d’adoption. Tant qu’un standard n’est pas lu par les agents, son émission reste une hypothèse.

La bonne façon d’envisager ces problématiques : les agents sont un nouveau type de client HTTP avec leurs contraintes propres. Et c’est tout…

Bibliographie

- Developer Experience with AI Coding Agents: HTTP Behavioral Signatures in Documentation Portals, étude empirique sur les signatures HTTP de neuf agents de codage et six assistants IA.

- Cloudflare Radar – AI Insights, données publiques sur le volume de trafic des crawlers IA.

- AGENTS.md – Open format for coding agents, spécification officielle du standard maintenu par l’Agentic AI Foundation.

- OpenAI co-founds the Agentic AI Foundation under the Linux Foundation, annonce de la création de l’AAIF en décembre 2025.

- The llms.txt file, proposition originale de Jeremy Howard.

- llms.txt adoption stalls as major AI platforms ignore proposed standard, analyse critique de l’adoption réelle.

- Google’s John Mueller on llms.txt, synthèse des positions publiques de Google.