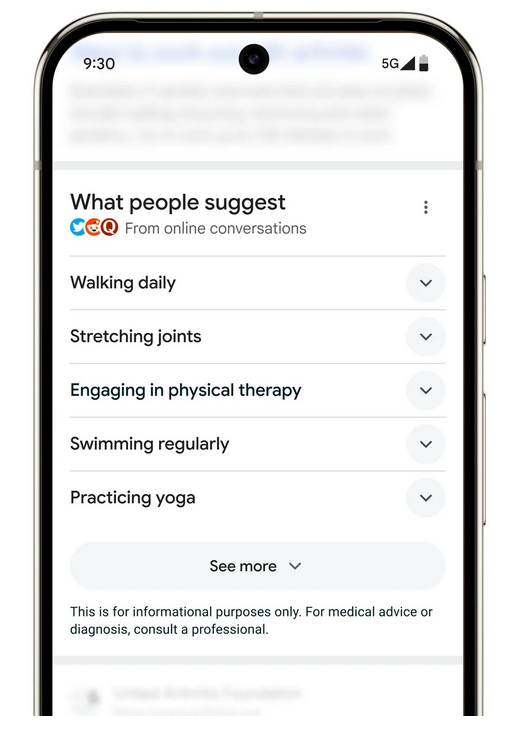

En mars 2025, Google lançait en grande pompe « What People Suggest », une fonctionnalité de recherche alimentée par l’intelligence artificielle, lors de son événement santé annuel The Check Up, à New York. Le principe : utiliser l’IA pour agréger et résumer des témoignages issus de forums et de réseaux sociaux (Reddit, Quora, X) en réponse à des requêtes médicales. Un utilisateur cherchant comment gérer ses douleurs articulaires pouvait ainsi voir apparaitre, directement dans les SERP (les pages de résultats de Google), un condensé de conseils tirés de discussions entre particuliers.

Karen DeSalvo, alors Chief Health Officer de Google, décrivait la fonctionnalité comme une démonstration du « potentiel de l’IA à transformer les résultats de santé à travers le monde ». Un an plus tard, le feature a été supprimé sans annonce dédiée. C’est le Guardian qui a révélé l’information mi-mars 2026, confirmée par trois sources internes et par un porte-parole de Google. La fonctionnalité n’a jamais été déployée en dehors des Etats-Unis et n’était disponible que sur mobile.

Des requêtes de santé « polluées » par du contenu UGC sans supervision médicale ?

Le problème central de « What People Suggest » résidait dans la nature de ses sources. La fonctionnalité s’appuyait sur le deal de données Google-Reddit, un accord de 60 millions de dollars signé en 2024, donnant à Google un accès exclusif au contenu de Reddit pour l’entrainement et l’alimentation de ses fonctionnalités IA. Contrairement aux études évaluées par les pairs ou aux recommandations cliniques, les fils de discussion Reddit et Quora ne font l’objet d’aucune supervision éditoriale ni vérification médicale.

En appliquant un traitement IA à ce contenu, Google élevait des anecdotes personnelles non vérifiées au même niveau de visibilité que les sources médicales faisant autorité. Concrètement, les résumés générés par l’IA apparaissaient en haut des résultats de recherche, leur conférant une apparence d’autorité qu’un simple post de forum n’aurait jamais eue de manière organique.

Les critiques ont souligné plusieurs risques structurels :

- L’IA peine à intégrer le contexte individuel (age, antécédents médicaux, symptomes spécifiques) qui détermine la pertinence d’un conseil de santé

- Les communautés de santé en ligne présentent un biais d’anecdote : elles attirent des utilisateurs aux expériences extrêmes, positives ou négatives, qui ne reflètent pas des résultats médicalement représentatifs

- Un commentaire sarcastique ou humoristique sur un forum peut être interprété par l’IA comme un conseil authentique

- Les avertissements invitant à consulter un professionnel n’étaient pas toujours mis en avant dans les résumés

L’enquête du Guardian : le détonateur

La suppression de « What People Suggest » intervient dans un contexte de pression croissante sur les fonctionnalités IA de Google en matière de santé. En janvier 2026, le Guardian publiait une enquête de fond révélant que les AI Overviews (les résumés générés par l’IA qui s’affichent en haut des résultats de Google) diffusaient des informations médicales fausses et potentiellement dangereuses auprès de deux milliards d’utilisateurs mensuels.

Parmi les erreurs documentées par l’enquête :

- Des conseils aux patients atteints de cancer du pancréas d’éviter les aliments riches en graisses, soit l’exact opposé des recommandations médicales, ce qui pourrait empêcher les patients de tolérer un traitement anticancéreux

- Des interprétations incorrectes de résultats de tests de la fonction hépatique, sans prise en compte des variantes liées à la nationalité, au sexe, à l’ethnie ou à l’age

- Des informations erronées sur le dépistage du cancer chez les femmes

Google a réagi en supprimant sélectivement les AI Overviews pour certaines requêtes médicales, notamment celles portant sur les tests hépatiques. Mais des variantes de ces mêmes requêtes continuaient à déclencher des résumés IA. L’entreprise avait dans un premier temps tenté de minimiser les conclusions de l’enquête, affirmant que les exemples partagés étaient des « captures d’écran incomplètes ».

Nous avions déjà traité ce sujet sur le Blogarithme Népérien :

La rhétorique de la « simplification »

Interrogé sur le retrait de « What People Suggest », un porte-parole de Google a attribué la décision à une « simplification plus large » de la page de résultats, niant tout lien avec la qualité ou la sécurité de la fonctionnalité. Quand on lui a demandé où cette suppression avait été communiquée publiquement, le porte-parole a renvoyé à un billet de blog publié en novembre 2025 par John Mueller, Search Advocate chez Google, portant sur la suppression de fonctionnalités de recherche peu utilisées.

Or ce billet ne mentionne pas « What People Suggest » par son nom. Cette communication par omission s’inscrit dans un pattern récurrent chez Google : des suppressions discrètes habillées en « simplification ». On retrouve la même logique dans la suppression du Dark Web Report en décembre 2025 (justifié par un manque d’utilité), ou la disparition du cache Google début 2024.

Ce décalage entre la communication officielle et la réalité soulève une question de transparence. Pour les professionnels du SEO habitués à décoder les annonces de Google, la réponse-type « simplification » fonctionne comme un signal : la fonctionnalité posait un problème que Google ne souhaite pas documenter publiquement.

Le double standard chez Google !

L’épisode illustre une contradiction structurelle dans la stratégie de Google. D’un coté, le moteur de recherche impose aux éditeurs des exigences croissantes en matière de E-E-A-T (Experience, Expertise, Authoritativeness, Trustworthiness, soit le cadre que Google utilise pour évaluer la qualité des contenus). Pour les thématiques YMYL (Your Money or Your Life, c’est-à-dire les sujets touchant à la santé, aux finances ou à la sécurité), les critères sont encore plus stricts : Google attend des preuves d’expertise médicale, de sources fiables, de contenu évalué par des pairs.

De l’autre, Google déployait une fonctionnalité qui agrègeait des témoignages non vérifiés de Reddit et Quora, les résumait via IA et les plaçait au sommet de la SERP, exactement là ou les contenus les plus fiables sont censés apparaitre.

Selon les données d’Ahrefs publiées en novembre 2025, les requêtes médicales de type YMYL déclenchaient des AI Overviews dans 44,1 % des cas, le taux le plus élevé parmi les catégories YMYL. L’investissement de Google dans l’IA appliquée à la santé ne faiblit pas, mais le cadre de qualité qu’il impose aux éditeurs ne semble pas s’appliquer à ses propres fonctionnalités.

The Check Up 2026 : un pivot stratégique sans mea culpa

Le retrait de « What People Suggest » est intervenu quelques jours avant The Check Up 2026, l’événement santé annuel de Google, désormais piloté par le Dr Michael Howell, qui a succédé à Karen DeSalvo comme Chief Health Officer en aout 2025. L’événement n’a fait aucune mention de la fonctionnalité supprimée.

Google y a en revanche annoncé plusieurs initiatives :

- Un investissement de 10 millions de dollars via Google.org pour financer la formation des cliniciens à l’IA, en partenariat avec le Council of Medical Specialty Societies et l’American Academy of Nursing

- Un bouton « Ask » alimenté par l’IA sur les vidéos YouTube de santé éligibles, permettant aux utilisateurs d’interagir avec le contenu (par exemple, demander une explication simplifiée d’un concept médical)

- Des expérimentations d’IA comme outil de brainstorming pour organiser l’information scientifique évaluée par les pairs

- De nouvelles fonctionnalités Fitbit : amélioration du suivi du sommeil, connexion de capteurs de glycémie, et possibilité de lier ses dossiers médicaux à l’application

Le pivot est significatif : Google passe d’une logique de crowdsourcing de témoignages non médicaux à un investissement dans l’éducation médicale et les outils cliniques encadrés.

YouTube, nouveau vecteur santé dominant

Le détail le plus stratégique de The Check Up 2026 concerne peut-être YouTube. Google annonce que les vidéos liées à la santé sur YouTube ont dépassé 1 000 milliards de vues au niveau mondial. Le nouveau bouton « Ask » transforme ces vidéos en interfaces conversationnelles.

Ce choix n’est pas anodin. Une étude de SE Ranking portant sur les requêtes santé en Allemagne a montré que YouTube était le domaine le plus cité dans les AI Overviews santé, devant les sites hospitaliers et les sites gouvernementaux. L’ajout d’une couche IA interactive sur ces vidéos pourrait renforcer cette domination de YouTube comme source de référence dans les résumés IA de Google.

Pour les éditeurs de contenus santé, la question se pose : si YouTube devient simultanément la source la plus citée par les AI Overviews et une plateforme dotée de son propre assistant IA embarqué, quel espace reste-t-il pour les sites d’information médicale indépendants dans l’écosystème Google ?

Ce qui change (et ce qui ne change pas)

La suppression de « What People Suggest » ne fait pas disparaitre les discussions communautaires des résultats de Google. Reddit, Quora et les forums de santé continuent de se positionner dans les résultats organiques. La différence : les utilisateurs doivent désormais cliquer pour accéder aux sources eux-mêmes, plutôt que de recevoir un résumé IA qui confère une autorité artificielle à des anecdotes non vérifiées.

Le bilan d’un an de « What People Suggest » pointe vers une tension fondamentale dans la stratégie IA de Google appliquée à la santé. L’entreprise investit massivement dans l’IA médicale (formation des cliniciens, outils Fitbit, recherche sur l’insulinorésistance publiée dans Nature), mais ses fonctionnalités grand public peinent à maintenir le niveau de fiabilité que le domaine exige. Les retraits successifs, d’abord les AI Overviews sur certaines requêtes médicales, puis « What People Suggest », suggèrent un ajustement par essai-erreur plutôt qu’un cadre de gouvernance stabilisé.

Pour le marché français, l’impact direct est nul : la fonctionnalité n’a jamais été déployée en France, et les AI Overviews ne sont toujours pas activés sur Google.fr. Mais la trajectoire américaine préfigure les arbitrages que Google devra opérer lorsqu’il étendra ses fonctionnalités IA santé à d’autres marchés.

Bibliographie

- Google scraps AI search feature that crowdsourced amateur medical advice – The Guardian, mars 2026

- Google Removes ‘What People Suggest,’ Expands Health AI Tools – Search Engine Journal, mars 2026

- How Google is using AI to improve health for everyone – Google Blog (The Check Up 2026), mars 2026

- Google Officially Removes « What People Suggest » Health SERP Feature – Search Engine Roundtable, mars 2026

- The Guardian: Google AI Overviews Gave Misleading Health Advice – Search Engine Journal, janvier 2026

- Google removes some health-related questions from its AI Overviews – Euronews, janvier 2026

- Google Scraps AI Feature That Pulled Health Tips from Reddit – WinBuzzer, mars 2026